Hello! 各位 AI 開發者大家好 👋

幾個我關注的消息:

🧠 大神 Andrej Karpathy 宣佈加入 Anthropic — 本週最大八卦新聞(AK 推文)

🔊 OpenAI 新的 Realtime Models — OpenAI 發了三個即時語音模型: GPT-Realtime-2(即時語音模型)、GPT-Realtime-Translate(70+ 語言即時翻譯)、GPT-Realtime-Whisper(串流語音轉文字)。(官方文章)

📊 社群風向: Claude 4.7 不如預期,GPT-5.5 好評 + Codex App 繼續大爆發 — Claude Opus 4.7 四月中出來後,社群體感覺得沒有明顯提升,甚至有退步的聲音。更讓 API 用戶不滿的是,4.7 換了新的 tokenizer,相同的輸入會產生多 20–45% 的 tokens(官方說法是 1.0–1.35x,Simon Willison 實測最高到 1.47x)。雖然每 token 單價沒變,但實際帳單是變貴的,OpenRouter 真實流量分析顯示成本增加 12–27%,等於是隱性漲價(分析1、2)。相比之下 GPT-5.5 評價普遍正面,Codex App 搭配 GPT-5.5 之後實用性再上一個台階,兩家競爭越來越激烈了。

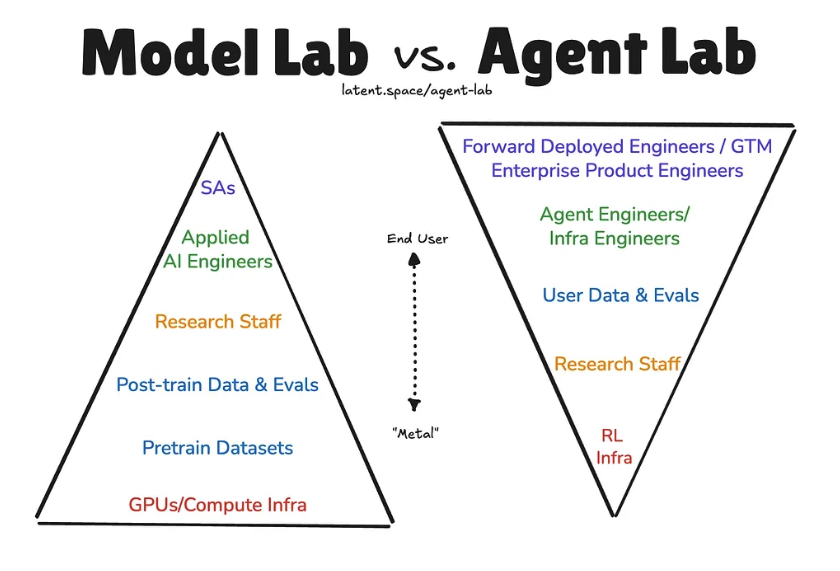

🪦 OpenAI API 關閉 fine-tuning 模型微調功能,至於 Claude API 從頭到尾都沒提供,Gemini API 曾經有但現在也關閉了(要在 Vertex AI 裡面還可以微調舊的 Gemini 2.5)。

對多數 AI 工程來說, 微調從來就不是主流路線。做 prompt/context/harness engineering 幾乎就夠忙了。

如果需要微調的話,現在只能用開源模型了。(我的觀察)

🤖 最近覺得厲害的黑科技: Interaction Models — 前 OpenAI CTO Mira Murati 創辦的 Thinking Machines Lab 發表了一個原生支援「邊說邊聽邊思考」的即時 AI 模型。目前的即時語音 AI(包括 OpenAI GPT-Realtime 和 Gemini Live)本質上還是「輪流說話」的回合制,要先透過 VAD 偵測你講完,模型才開始回覆。而這個 Interaction Models 透過每 200 毫秒的微輪次,讓模型不再有明確的「你的回合 / 我的回合」邊界,持續同時處理音訊、影像和文字三模態,還有前台互動模型 + 後台推理模型的雙層架構。

他們設計的幾個全新 benchmark(主動開口、適時插話、即時辨識影片動作邊界等),用 GPT-Realtime-2.0 測幾乎都是零分,因為回合制架構根本無法處理「持續感知 + 主動回應」的任務。推薦看他們網頁上 Figure 8 的 demo,體驗完全不同等級。沒想到即時互動可以做到這種程度,Realtime AI 的天花板被往上推了一大截。(我的觀察)

📺 Google I/O 2026 — 有興趣的可以去看 Google 官方整理的 100 項公告。

⬇️ 以下是自上期以來,使用 AI 整理生成的文章 ⬇️

內容很多,我就不一一點評摘要了,特別推薦的我放個 👍

閱讀全文〈愛好 AI Engineer 電子報 🚀 大神 AK 加入 Anthropic #37〉