在講完 WebConf 之後,我有種莫名的不協調感: 一方面 Vibe Coding 讓大家寫程式變簡單了,人人都可以做 App 了,也很多人講硬技能不重要了。但另一方面,我覺得開發 AI Agent 產品仍是非常有技術挑戰性的,需要的知識技能深度廣度一點都不少。

最近也看到了幾篇關於 AI Agent 開發的文章,發現國外技術社群在 2025 Q4 也有類似的體悟: Agent 產品開發設計還是很難。

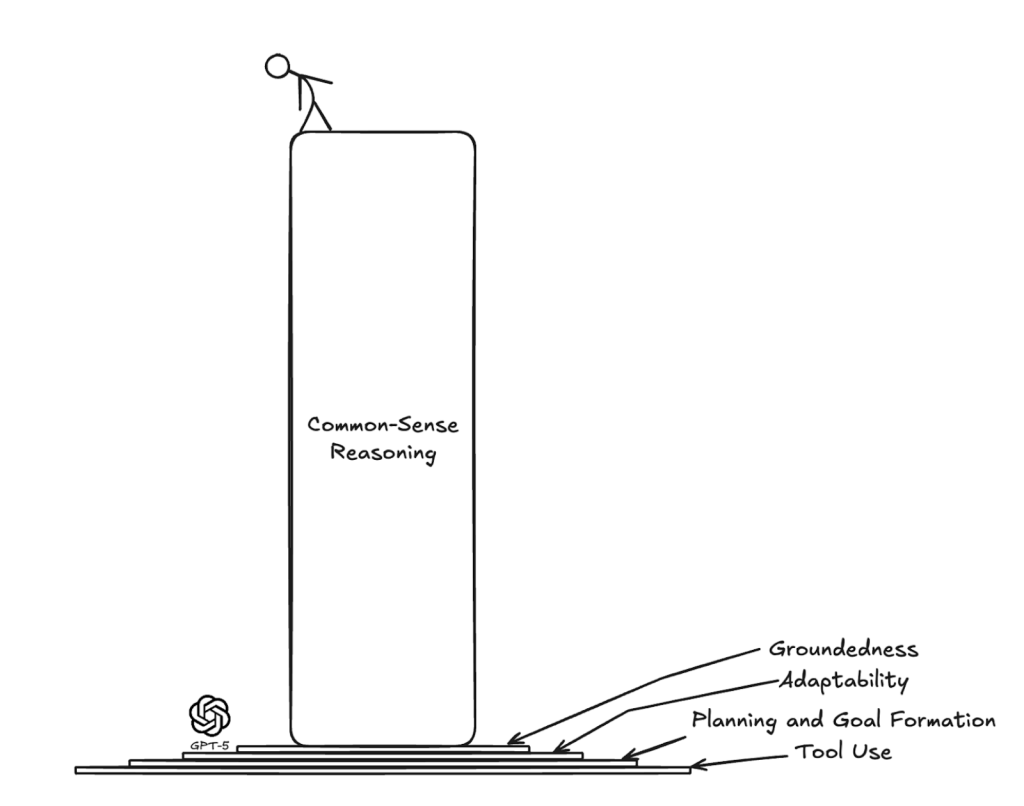

不是「寫程式很難」那種難,而是「95% 的 AI Agent 產品,進到正式環境會失敗」這種難。問題不在模型不夠聰明,而在於周邊的工程架構: context 管理、memoy 設計、錯誤處理、agent prompt 最佳化、語意檢索、評估回饋機制等等,很多都是全新領域,且戰且走的情況。模型只能用幾個月就要升級更換,幾個月前的 best practice 也可能會被推翻重新思考。

總之,以下我整理年底四篇我覺得關於 Agent 開發氛圍的不錯文章:

閱讀全文〈AI Agent 產品開發仍然不簡單〉