Hello! 各位 AI 開發者大家好 👋

我是 ihower,這次過年好忙,又是 DeepSeek R1 又是 OpenAI o3-mini,真是春捲啊 🌯🌯🌯

🔝 AI 大神免費深入淺出全面講解大型語言模型、訓練、心理學到實際應用

大神 Andrej Karpathy (前 OpenAI 共同創辦人、特斯拉人工智慧總監) 寫的這個 LLM 模型訓練的比喻(出處 tweet)太讚了,這裡翻譯分享給大家:

讓大型語言模型 (LLMs) 去上學:

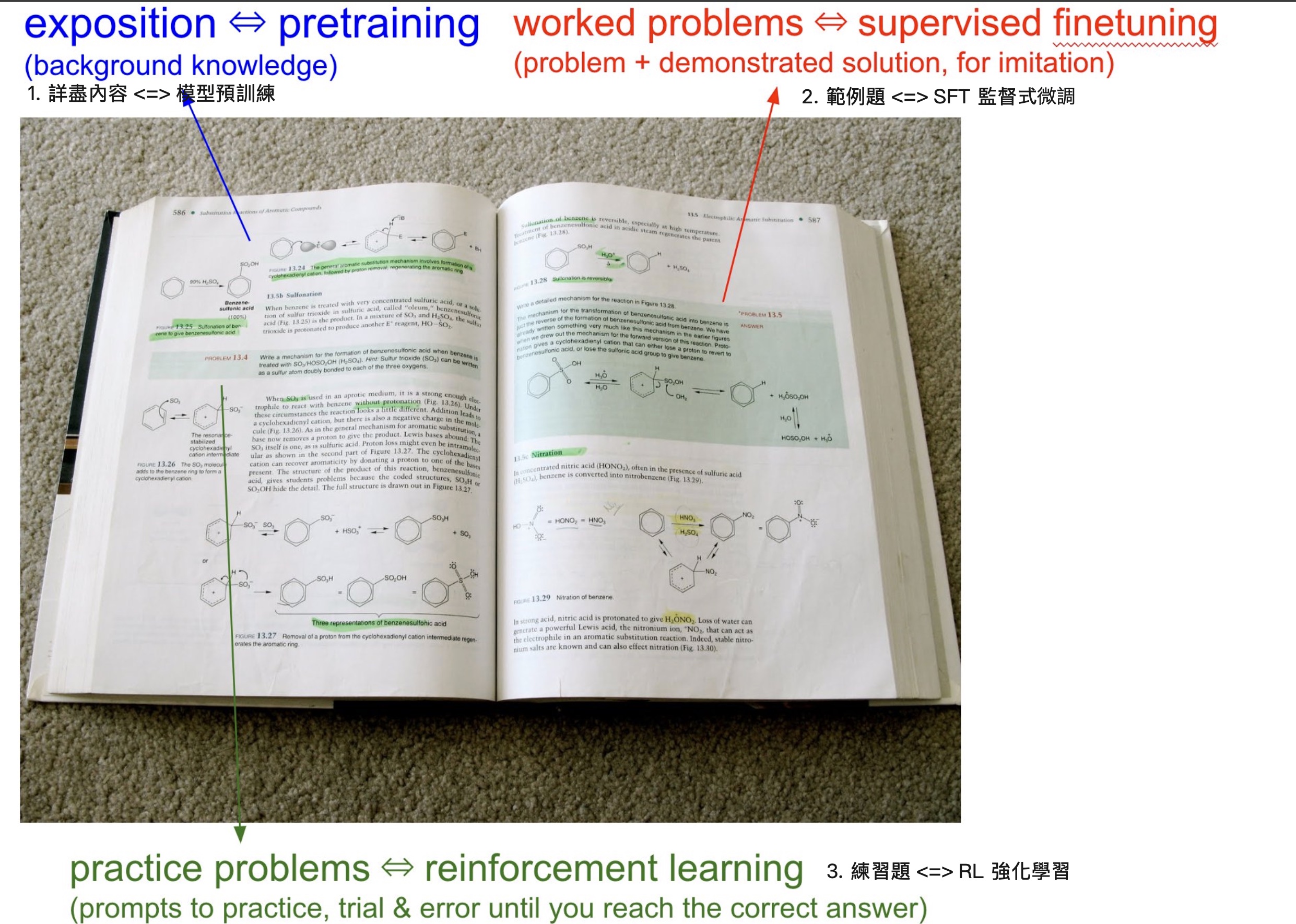

當你打開任何一本教科書時,你會看到三種類型的主要內容:

- 背景資訊/解說: 這部分是教科書的主要內容,用來解釋各種概念。當你專注閱讀時,大腦正在把這些內容進行學習與訓練。這就相當於「預訓練」(pretraining),模型透過閱讀網路資料,累積背景知識。

- 有解答過程的範例題: 這些是專家如何解題的具體案例,示範給學生來模仿學習。對模型來說,這就相當於「監督式微調」(supervised finetuning,縮寫是 SFT),也就是讓模型根據人類撰寫的「理想回覆」來做微調,來提升作為 AI 助理的表現。

- 練習題: 這些是給學生的練習題目,通常不會提供解題過程,但都會附上最終答案。每章最後通常會有大量這種題目,目的在於讓學生透過反覆嘗試來學習 – 學生必須嘗試各種方法才能得到正確答案。對模型而言,這相當於「強化學習」(reinforcement learning,縮寫是 RL)

目前我們已經讓模型接受大量的第 1 類(背景知識) 和第 2 類(範例學習)訓練,但第 3 類(練習與試誤學習) 仍然是個新興逐漸開展的新領域。

當我們為模型建立訓練資料集時,本質上與撰寫教科書並無不同,需要同時包含這三種類型的資料。它們必須先閱讀,然後再做大量練習。

大神還接著錄了三個多小時的教學影片,免費深入淺出全面講解大型語言模型、訓練、心理學到實際應用!

這裡感恩 Fox 大大翻譯繁體中文字幕。